Jacek Cieślak

APEX Service Manager

Trzech naszych kolegów z zespołu Apex wzięło na siebie dużą odpowiedzialność. Wystąpili podczas tegorocznego Data Science Summit na PGE Narodowym. To największa w regionie Europy Środkowo-Wschodniej niezależna konferencja data science. Nie mogło nas na niej zabraknąć.

Sala pełna ludzi czekających na to, co powiemy. Wszystkie oczy skupione na nas. Kilka aparatów wymierzonych w naszą stronę, kamera rejestrująca każdy ruch, mikrofony w rękach, które zdają się ważyć tonę. To zdecydowanie nie jest świat, w którym poruszamy się na co dzień. Ale nadarzyła się świetna okazja, podczas której ten świat mogliśmy poznać od podszewki. Dlaczego od podszewki? Bo nie ma lepszego sposobu na odkrycie prawdziwego charakteru konferencji technologicznej, niż występ podczas niej. Chodzi oczywiście o listopadową konferencję Data Science Summit. A jeśli dodamy do tego tytuł naszej prelekcji: "Navigating the Data Storm - our journey from DataLake on AWS to Databricks", to wiadomo, że nie chodziło tylko o odważne zmierzenie się z technologiczną burzą danych, ale również o sztukę utrzymania równowagi na tej burzy danych. Zatem, przygotujcie się na opowieść o tym, jak na szczycie technologicznej fali trzymaliśmy się mocno… i to przez całe 30 minut!

Data Science Summit 2024 była pierwszą konferencją tej skali, w której uczestniczyliśmy jako oficjalni reprezentanci i prelegenci Raiffeisen Tech. Mówiąc my, czas najwyższy się przedstawić:

Udział w Data Science Summit był świetną okazją do zgłębienia najnowszych trendów w dziedzinie zarządzania danymi, uczenia maszynowego i transformacji cyfrowej. Mogliśmy wymienić doświadczenia z ekspertami z różnych branż oraz zapoznać się z innowacyjnymi rozwiązaniami stosowanymi przez liderów rynku. Szczególnie doceniliśmy możliwość uczestniczenia w sesjach warsztatowych, które pozwoliły nam poznać najnowsze narzędzia i technologie wykorzystywane w procesach analitycznych oraz zarządzaniu danymi.

W czasie tegorocznego Data Science Summit 2024 przeprowadziliśmy prelekcję zatytułowaną “Navigating the Data Storm - Our Journey from Data Lake on AWS to Databricks”. Podzieliliśmy się doświadczeniami z transformacji infrastruktury danych. W prezentacji omówiliśmy wyzwania, strategie oraz korzyści płynące z migracji z tradycyjnego Data Lake na AWS do platformy Databricks. Poniżej przedstawiamy szczegółowe podsumowanie każdej z trzech części wystąpienia, kładąc nacisk na kluczowe aspekty omawiane podczas prelekcji.

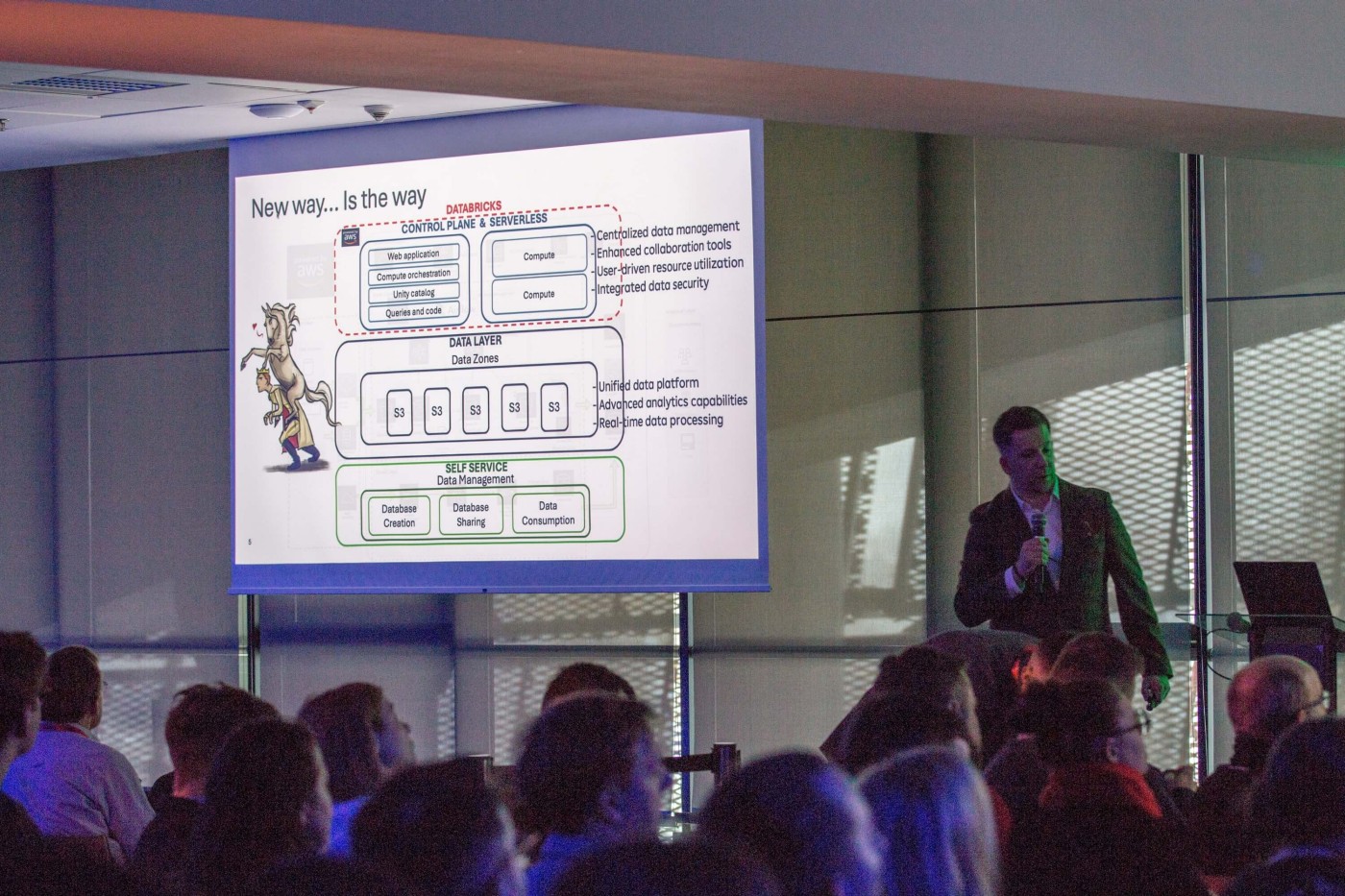

Pierwsza część prezentacji spadła na mnie – Jacka. Omówiłem przejście z tradycyjnego Data Lake na platformie AWS do Databricks, podkreślając, że głównym celem migracji była optymalizacja zarządzania danymi, eliminacja problemów związanych z ograniczeniami starej infrastruktury i centralizacja danych całej grupy RBI w jednym miejscu.

Korzyści z migracji do Databricks są następujące:

Omówiłem również problemy związane z szybkim rozwojem platformy oraz jej integracją z rozwiązaniami starszymi (legacy) lub lokalnymi (on-premise). Zwykle przyczyniają się one do różnych przeszkód, takich jak spowolnienie procesu udostępniania i dostępu do zasobów, skomplikowane zarządzanie łącznością sieciową i modelami uprawnień w całej grupie czy udostępnianie danych między projektami centrali a projektami NWB.

Na koniec odniosłem się do rozwiązania Self-Service, które jest obecnie intensywnie rozwijane i wkrótce zostanie udostępnione użytkownikom. Więcej na ten temat opowie Robert w swojej części.

Podczas drugiej części wystąpienia scena należała do Roberta Marka, który przedstawił potrzeby samoobsługi w kontekście przetwarzania danych. Omówił dwie alternatywne ścieżki rozwoju tego obszaru, rozważając zalety i wady każdej z nich.

Eksploracja alternatywnych podejść:

Robert przedstawił też narzędzia wspierające model samoobsługowy, w tym alerty monitorujące opóźnienia w dostarczaniu danych, które umożliwiają efektywniejsze zarządzanie potokami danych. Zwrócił również uwagę na znaczenie standaryzacji procesów, aby uniknąć zbędnych opóźnień i złożoności.

Na koniec zwrócił uwagę, że platforma została zaprojektowana tak, aby umożliwiać bezproblemowy dostęp do danych i przyjazne dla użytkownika zarządzanie, jednak jest z natury złożona i musi działać zgodnie z wymaganiami naszej grupy RBI. Wymaga to dokładnego planowania i starannego zarządzania.

Last but not least - Mateusz Wujec – który omówił wyzwania związane z zarządzaniem jakością danych oraz testowaniem z perspektywy inżyniera danych. Mateusz podkreślił znaczenie systematycznej analizy danych, zwracając uwagę na kilka kluczowych narzędzi i procesów:

Mateusz wskazał też, że największym wyzwaniem było zarządzanie jakością danych, pochodzących z zewnętrznych systemów. Podkreślił, że pełna poprawa jakości wymaga nie tylko lepszych narzędzi, ale także współpracy z dostawcami danych.

Jednym z kluczowych zagadnień poruszonych przez Mateusza było testowanie procesów CI/CD. Dzięki zastosowaniu narzędzi takich jak Terraform i GitHub Actions, infrastruktura jako kod została znacznie usprawniona. Niemniej jednak, testowanie potoków w notebookach Databricks pozostaje wyzwaniem, nad którym zespół wciąż intensywnie pracuje.

Chyba nikogo nie zdziwi, że oczywiście, nie obyło się bez odrobiny stresu. Pomimo małego dreszczyku emocji, wszystko poszło zgodnie z planem. Prezentacja zakończyła się sesją pytań i odpowiedzi, która pozwoliła nam jeszcze bardziej pogłębić omawiane tematy. Dyskusja, która się wywiązała, pokazała, jak bardzo temat transformacji infrastruktury danych jest na czasie. Wspólnie z uczestnikami konferencji przekonaliśmy się, jak ważna w dzisiejszym świecie zarządzania danymi jest elastyczność, współpraca i standaryzacja procesów. Mimo trudności, migracja do Databricks okazała się kluczowym krokiem w optymalizacji procesów przetwarzania danych. Dała naszym zespołom większą autonomię, a przy tym zapewniła wysoki poziom jakości i bezpieczeństwa danych. To był dzień pełen wyzwań, ale i satysfakcji z osiągniętych celów!

Podzieliliśmy się tam nie tylko wyzwaniami, które napotkaliśmy podczas tej transformacji, ale również rozwiązaniami, które okazały się kluczowe dla sukcesu całego procesu. Jak wyglądała nasza droga przez burzę danych – od planowania, przez implementację, aż po finalny efekt, który zrewolucjonizował nasze podejście do przetwarzania danych.

Jeśli zaciekawiliśmy Was tematem migracji z DataLake na AWS do Databricks i chcecie poznać szczegóły naszej technologicznej podróży, zapraszamy do obejrzenia nagrania, które w anglojęzycznej wersji znajdziecie na naszym Tech Blogu oraz na Youtube. Zapraszamy też do zapoznania się z prezentacją w języku angielskim, którą omawialiśmy podczas naszego wystąpienia.

APEX Service Manager